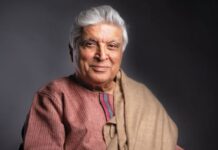

>> प्रसाद ताम्हनकर

काही दिवसांपूर्वी अहमदाबाद इथे अत्यंत दुर्दैवी अशी विमान दुर्घटना घडली. अशा दुर्दैवी घटनेचा वापरदेखील काही सोशल मीडिया इन्फ्लुएन्सर्सनी स्वतःची फॅन फोलोइंग वाढवण्यासाठी आणि प्रसिद्धीसाठी करून घेतला. सतत खोट्या आणि दिशाभूल करणाऱ्या बातम्या, अपघातामागे अतिरेकी हल्ला असल्याची हूल उठवणे, अपघातात वाचलेल्या एकमेव माणसाविषयी चुकीची माहिती पसरवणे असे अनेक उद्योग या लोकांनी केले. या लोकांची मजल तर अपघातात मृत पावलेल्या लोकांचे फोटो वापरणे, ते AI च्या मदतीने जनरेट करणे इथपर्यंत जाऊन पोहोचली. शेवटी अपघातात मृत पावलेल्या व्यक्तींच्या काही कुटुंबांना सोशल मीडियावर हात जोडून हे सगळे थांबविण्याची मागणी करावी लागली.

प्रसिद्धी आणि झटपट मिळणारा पैसा यासाठी काही लोक, काही स्वयंघोषित बातमीपत्र किती खालच्या थराला गेले आहेत हे अहमदाबाद प्रकरणानंतर आता इस्रायल आणि इराण यांच्यात चालू असलेल्या संघर्षात पाहायला मिळते आहे. आर्टिफिशल इंटेलिजन्स (AI) अर्थात कृत्रिम बुद्धिमत्तेच्या मदतीने तयार करण्यात आलेल्या खोटय़ा व्हिडीओ आणि फोटोंची सोशल मीडियावर अक्षरश लाट उसळली आहे. लोकदेखील डोळे झाकून अशा खोटय़ा माहितीवर विश्वास ठेवत आहेत. या खोटय़ा प्रचार करणाऱ्या व्हिडीओपैकी काही व्हिडीओ चक्क कॉम्प्युटर गेम्समधून चोरण्यात आलेले आहेत आणि लोक त्यांना खऱ्या युद्धाचे व्हिडीओ समजत आहेत.

इराणच्या हल्ल्यात इस्रायलची कशी वाताहत झाली आहे हे दाखविणारे खोटे व्हिडीओ सर्वात जास्त प्रसारित करण्यात येत आहेत. तेल अविव शहराचे उद्ध्वस्त झालेले फोटो, व्हिडीओ यामध्ये प्रामुख्याने समाविष्ट आहेत. हे खोटे फोटो आणि व्हिडीओ खास करून रात्रीच्या अंधारात टिपल्याचे दाखवले आहे. त्यामुळे सायबर तज्ञांनादेखील त्याचा खरेखोटेपणा तपासणे अवघड झाले आहे. इराण समर्थकांच्या तोडीस तोड बनावटगिरी काही इस्रायल समर्थक करत आहेत. इराणमध्ये युद्धामुळे सरकारविरुद्ध जन आक्रोश उभा राहिला आहे, लोक रस्त्यावर उतरले आहेत, मोठमोठय़ा सभांमध्ये सरकारचा निषेध केला जातो आहे असे AI ने बनवलेले खोटे व्हिडीओ जोमाने सोशल मीडियावर प्रसारित केले जात आहेत.

आजवरच्या इतिहासात सोशल मीडियावर AI चा इतका चुकीचा वापर कधी झाला नसल्याचे तज्ञ सांगतात. मुख्यत रात्रीच्या हल्ल्यांचे हे व्हिडीओ असले तरी या खोटय़ा व्हिडीओपैकी एफ-35 या लढाऊ विमानाचा खोटा व्हिडीओ जगभरात सर्वात जास्त वेळा पाहिला गेला आहे. AI द्वारे निर्मित या व्हिडीओमध्ये वाळवंटात पडलेले एफ-35 हे लढाऊ विमान दाखविण्यात आले आहे आणि हे अमेरिकेचे अत्याधुनिक विमान इराणने पाडल्याचा दावा करण्यात आला आहे. एफ-35 हे अत्यंत प्रगत असे विमान असून त्याच्या मदतीने जमीन आणि हवाई असे दोन्ही प्रकारचे हल्ले करता येतात.

टिकटॉकसारख्या माध्यमावरदेखील एफ-35 पाडल्याचा असाच एक खोटा व्हिडीओ मोठय़ा प्रमाणावर प्रसारित होत आहे. मात्र तज्ञांनी जेव्हा त्याचे परीक्षण केले तेव्हा तो प्रत्यक्षात एका सिम्युलेटर व्हिडीओ गेममधून घेतल्याचे स्पष्ट झाले आहे. अर्थात हा व्हिडीओ कॉम्प्युटर गेमचा एक भाग आहे. काही तज्ञांनी एफ-35 चे खोटे व्हिडीओ प्रसारित होण्यामागे रशियन वापरकर्त्यांचा मोठा हात असण्याची शक्यता व्यक्त केली आहे. युक्रेन युद्धात अमेरिकेचा त्यांना मिळणारा पाठिंबा रशियाला खटकतो आहे. अशातच एफ-35 सारख्या ताकदवान विमानाची तोड रशियाकडे नाही. अशा वेळी हे विमान पाडल्याची दिशाभूल करणारी माहिती प्रसारित करून अमेरिका आणि तिच्या ताकदवान मानल्या जाणाऱ्या युद्धसामग्रीविषयी जगभरात शंका निर्माण करणे हा यामागचा हेतू असल्याची शंका तज्ञ व्यक्त करत आहेत.

निवडणुका असोत, मनोरंजन असो किंवा युद्ध आणि नैसर्गिक आपत्तींचे संकट असो, AI च्या माध्यमातून पसरवली जाणारी दिशाभूल ही आता एक जागतिक समस्या बनत चाललेली आहे. अशा वेळी कोणत्याही गोष्टीची खात्री पटल्याशिवाय तिच्यावर विश्वास ठेवू नका आणि अशा गोष्टी पसरवण्यास हातभार लावू नका अशी सर्वांना विनंती.